Vor Zurück Inhalt

2. Künstliche Gefühle

Der bekannteste emotionale Computer aller Zeiten ist wohl HAL 9000 aus dem Film "2001 - A Space Odyssey". War die Vision einer dem Menschen gleichwertigen, wenn nicht sogar überlegenen Künstlichen Intelligenz bereits ein Schock für viele Kinobesucher, so war es noch furchteinflößender, daß diese Maschine sogar Gefühle hatte - und deswegen letztendlich die Menschen an Bord vernichtete.

Es war wahrscheinlich kein Zufall, daß einer der Berater von Regisseur Stanley Kubrick Marvin Minsky war, einer der Väter der Künstlichen Intelligenz. Für ihn ist der "emotionale Computer" eine durchaus realistische Version:

" ...I don't think you can make AI without subgoals, and emotion is crucial for setting and changing subgoals. Kubrick probably put the emotion in to make good cinema, but it also happens to be very good science. For instance, HAL explains that the Jupiter mission is too important to be jeopardized by humans. It is through emotion that he sets the goals and subgoals, ultimately killing the humans..."

(Stork, 1997, S. 29)

Inzwischen haben auch die Vertreter der Künstlichen Intelligenz erkannt, wie wichtig Emotionen für einen "intelligenten" Computer sind. Diese Einsicht ist weniger erwachsen aus einer tiefen Reflexion über das Thema, sondern eher aus dem Versagen der klassischen AI. Das neue Schlagwort heißt nun nicht mehr Artificial Intelligence, sondern AE, also Artificial Emotions.

Die Vorstellung eines emotionalen Computers ist, ebenso wie die Vorstellung eines intelligenten Computers, für die meisten Menschen eher eine Bedrohung als eine hoffnungsvolle Vision. Andererseits geht von einer solchen Vorstellung eine merkwürdige Faszination aus. Nicht umsonst spielen intelligente und auch emotionale Maschinen in der populären Kultur eine nicht unbedeutende Rolle.

Neben dem genannten HAL ist es zum Beispiel der Terminator , der, im Film "Terminator 2" von James Cameron, zwar ein Roboter ohne jegliche Gefühle ist, aber im Verlauf des Films lernt, menschliche Gefühle zu verstehen. In einer Szene sieht es sogar so aus, als würde er selber eine Emotion erleben - ob das wirklich so ist, darüber läßt uns der Regisseur jedoch im Unklaren. Ein weiteres Beispiel ist der Roboter aus "Nummer 5 lebt", der sich von einer Kriegsmaschine in einen guten "Menschen" verwandelt.

Roboter werden, zumindest in der populären Kultur, als fremdartige Wesen beschrieben, deren Charakter vorwiegend bedrohlich ist. Diese Eigenschaft teilen sie mit den "echten" Außerirdischen, den "Aliens". Denken wir nur an Mr. Spock aus "Star Trek", dessen Verstand nur Logik, aber keine Emotionen kennt - wie bei allen Bewohnern seines Heimatplaneten Vulkan. Und dennoch wird uns im Verlauf der Serie immer wieder vor Augen geführt, daß es ganz ohne Gefühle auch bei ihm nicht geht.

Und selbst das Monster "Alien" aus der gleichnamigen Filmreihe erschreckt uns Menschen zwar durch seine bösartige Intelligenz, ist aber, wie zumindest die letzte der vier Folgen deutlich macht, vor rudimentären Gefühlen nicht gefeit.

Es ließe sich also schlußfolgern, daß eine fremde Intelligenz eigentlich nur dann für uns Menschen wirklich existentiell bedrohlich wird, wenn sie zumindest über ein Minimum an Emotionen verfügt. Denn wenn sie nur aus reiner Logik bestünde, wäre ihr Verhalten vorhersagbar und vom Menschen letztendlich beherrschbar.

So ist es kein Wunder, daß die Emotionen nun auch Einzug gehalten haben in die Künstliche Intelligenz. Die Forschungsgruppe "Affective Computing" am MIT erläutert die Notwendigkeit, emotionale Computer zu entwickeln, wie folgt:

"The importance of this follows from the work of Damasio and others who have studied patients who essentially do not have "enough emotions" and consequently suffer from impaired rational decision making. The nature of their impairment is oddly similar to that of today's boolean decision-making machines, and of AI's brittle expert systems. Recent findings indicate now that in humans, emotions are essential for flexible and rational decision making. Our hypothesis is that they will also be essential for machines to have flexible and rational decision making, as well as truly creative thought and a variety of other human-like cognitive capabilities."

(Affective Computing Home Page)

Obgleich die Arbeiten Damasios jüngerer Natur sind, ist die hier vertretene Position nicht neu, sondern läßt sich zurückführen auf die sechziger Jahre. Allerdings ist sie, zumindest in der Künstlichen Intelligenz, wieder in Vergessenheit geraten. Die Unfähigkeit von Computern, komplexe Handlungen mit einem hohen Maß an Selbständigkeit auszuführen, hat das Interesse an diesem Ansatz jedoch wiederbelebt.

Lag der Schwerpunkt der AI-Forschung in der Vergangenheit eher bei der Repräsentation von Wissensbeständen, so konzentriert man sich heute auf die Entwicklung "intelligenter autonomer Agenten".

Das Interesse an autonomen Agenten resultiert aus einer Reihe von praktischen Anforderungen, z.B. aus der Raumfahrt. So ist es zum Beispiel wünschenswert, zur Erkundung ferner Planeten Roboter einzusetzen, die ihre Aufgaben dort selbständig wahrnehmen können, da eine Fremdsteuerung, z.B. aufgrund der großen Entfernung, nur schwierig zu realisieren wäre. Eine weitere Kategorie autonomer Agenten sind Software-Agenten, die eine Vielfalt von unterschiedlichen Tätigkeiten ausüben können. Im Vordergrund stehen dabei Aufgaben der Informationssammlung, zum Beispiel im Internet.

Franklin und Graesser definieren einen autonomen Agenten wie folgt:

"An autonomous agent is a system situated within and part of an environment that senses that environment and acts on it, over time, in pursuit of its own agenda and so as to effect what it senses in the future."

(Franklin und Graesser, 1996, S. 4)

Picard formuliert den Einsatzbereich für "emotionale" autonome Agenten etwas spezifischer:

"One of the areas in which computer emotions are of primary interest is software agents, computer programs that are personalized - they know the user's interests, habits and preferences - and that take an active role in assisting the user with work and information overload. They may also be personified, and play a role in leisure activities. One agent may act like an office assistant to help you process mail; another may take the form of an animated creature to play with a child."

(Picard, 1997, S. 193f.)

Gemäß dieser Definitionen können autonome Agenten als reine Softwarelösung implementiert werden - eine Einschränkung, die von einer Reihe von Forschern abgelehnt wird. So definiert Brustoloni (1991) einen autonomen Agenten z.B. als ein System, das zu autonomem, zielgerichteten Handeln in einer realen Welt fähig ist, welches eine angemessene und zeitnahe Reaktion auf externe Reize darstellt.

Auch Pfeifer (1996) hält die physische Implementation für eine unverzichtbare Voraussetzung eines autonomen Agenten, insbesondere dann, wenn er über Emotionen verfügen soll. Seine vier Grundprinzipien für einen "Real Life"-Agenten nach dem "Fungus-Eater-Prinzip" (s.u.) lauten:

a) autonomy

Der Agent muß ohne menschliche Intervention, Supervision oder Anweisung funktionieren können.

b) self-sufficiency

Der Agent muß sich selbst über eine längere Zeit funktionsfähig erhalten können, d.h., seine Energieressourcen konservieren bzw. auffüllen können, seine technischen Funktionen instandhalten bzw. reparieren können usw.

c) embodiment

Der Agent muß über einen physischen Körper verfügen können, über den er mit der physischen Welt interagieren kann. Dieser Körper ist besonders wichtig:

"Although simulation studies can be extremely helpful in designing agents, building them physically leads to surprising new insights...Physical realization often facilitates solutions which might seem hard if considered only in an information processing context."

(Pfeifer, 1996, S. 6)

d) situatedness

Der Agent muß seine gesamte Interaktion mit der Umwelt selbst kontrollieren können und seine eigenen Erfahrungen in seine Interaktion mit der Umwelt einbringen können.

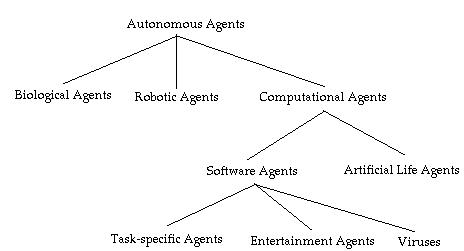

Eine Taxonomie für autonome Agenten, wie sie von Franklin und Graesser (1996) vorgelegt wurde, macht deutlich, daß sich danach autonome Agenten aller Art fundamental nicht von Menschen unterscheiden:

Abb. 1: Taxonomie autonomer Agenten (Franklin und Graessner, 1996, S. 7)

Die Forderung nach einer physischen Implementation ist es, die die Bereiche der Robotik und der Künstlichen Intelligenz zusammengeführt hat. Im Rahmen dieser Zusammenarbeit sind einzelne Aspekte der genannten Prinzipien bereits realisiert worden; allerdings gibt es keine Implementation eines kompletten Systems, das all diesen Ansprüchen genügen würde.

Trotz des vermehrten Interesses an autonomen Agenten müssen die Versuche, intelligente Maschinen zu schaffen, bislang alle als gescheitert angesehen werden, auch wenn zum Beispiel Simon (1996) etwas anderes behauptet. Franklin (1995) skizziert sehr anschaulich die drei wesentlichen AI-Debatten der letzten 40 Jahre, die jeweils aus dem Versagen der vorhergehenden Ansätze erwachsen sind.

Dabei steht ohne Zweifel, daß jedes dieser Versagen die Entwicklung intelligenter Maschinen vorangetrieben hat - aber, so Picard (1997), immer noch fehlt ein wesentlicher Teil. Und dieser Teil sind die Gefühle.

Es ist interessant, daß das wachsende Interesse an Emotionen in der AI-Forschung eine Parallele hat im wachsenden Interesse der Kognitionspsychologie an Emotionen. Fristeten die Emotionstheoretiker in den letzten Jahrzehnten eher ein etwas randständiges Dasein, erleben auch sie seit einigen Jahren bereits eine Aufwertung. Dazu haben mit Sicherheit auch Erkenntnisse der Neurowissenschaften (siehe z.B. LeDoux, 1996) beigetragen, die dem emotionalen Subsystem eine weitaus höhere Bedeutung für das Funktionieren des menschlichen Geistes zuschreiben als bislang angenommen.

Eine weitere Parallele ist zu beobachten im wachsenden Interesse am Thema "Bewußtsein". Auch diese Diskussion ist vornehmlich aus den Kreisen der Künstlichen Intelligenz, der Neurowissenschaften und der Philosophie in die Psychologie hineingetragen worden. Bereits ein kursorischer Blick durch einige der wesentlichen Publikationen zeigt jedoch, daß sich hier die alte Dichotomie zwischen Kognition und Emotion fortsetzt: Nahezu keines der vorliegenden Werke zum Thema consciousness setzt sich mit Emotionen auseinander.

Dabei ist es unbestritten, daß zumindest eine Reihe von Emotionen ohne Bewußtsein nicht existieren können. Im besonderen sind das all die Emotionen, die eine Konzeption vom "Selbst" voraussetzen, zum Beispiel Scham. Ohne hier näher auf die Diskussion um "primäre" und "sekundäre" Emotionen eingehen zu wollen, läßt sich feststellen, daß es Emotionen gibt, die unabhängig von Bewußtsein auftreten; aber ebenso Emotionen, die Bewußtsein voraussetzen.

Zusammenfassend läßt sich festhalten, daß derzeit die Impulse für die Konstruktion realer emotionaler Systeme vorwiegend aus drei Disziplinen kommen: aus der Robotik, aus der Künstlichen Intelligenz und aus der Kognitionswissenschaft. Die "klassische" emotionspsychologische Forschung verhält sich bislang eher zurückhaltend bis abwartend, sowohl bei der Rezeption der Forschungsbeiträge aus diesen Bereichen als auch bei der Lieferung eigener Beiträge.

Vor Zurück Inhalt